Презентація на тему:

Прогнозування за допомогою нейронних мереж

Завантажити презентацію

Прогнозування за допомогою нейронних мереж

Завантажити презентаціюПрезентація по слайдам:

Означення нейронної мережі Штучні нейронні мережі (ШНМ) – це математичні моделі, а також їх програмні або апаратні реалізації, побудовані за принципом організації й функціонування біологічних нейронних мереж – мереж нервових кліток живого організму. Нейронні мережі не програмуються у звичному змісті цього слова, вони навчаються. Можливість навчання – одне з головних переваг нейронних мереж перед традиційними алгоритмами. LOGO

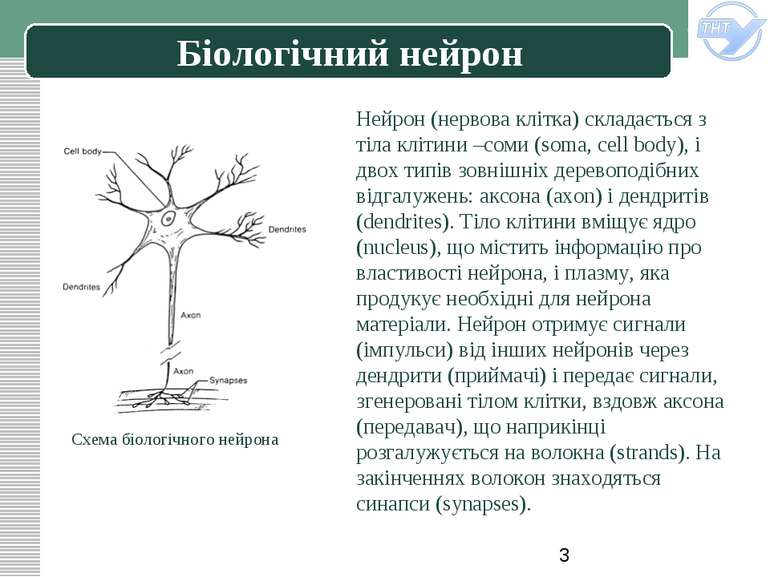

Біологічний нейрон Нейрон (нервова клітка) складається з тіла клітини –соми (soma, cell body), і двох типів зовнішніх деревоподібних відгалужень: аксона (axon) і дендритів (dendrites). Тіло клітини вміщує ядро (nucleus), що містить інформацію про властивості нейрона, і плазму, яка продукує необхідні для нейрона матеріали. Нейрон отримує сигнали (імпульси) від інших нейронів через дендрити (приймачі) і передає сигнали, згенеровані тілом клітки, вздовж аксона (передавач), що наприкінці розгалужується на волокна (strands). На закінченнях волокон знаходяться синапси (synapses). Схема біологічного нейрона LOGO

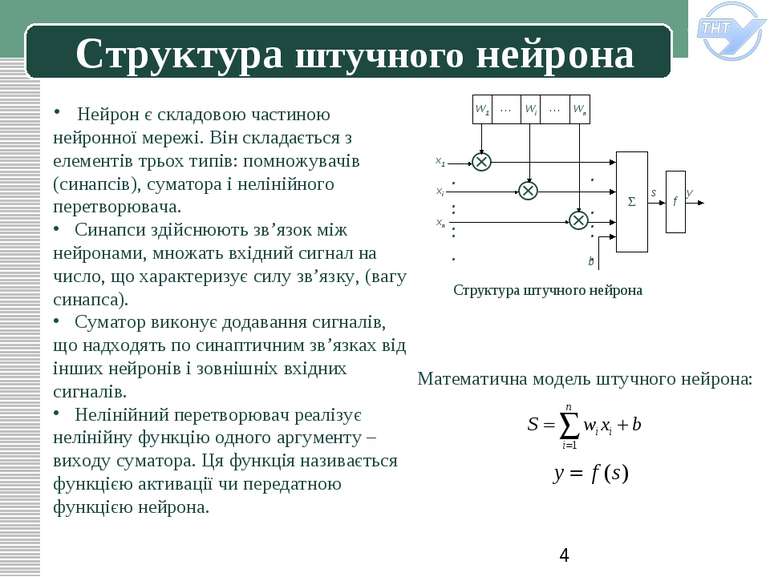

Структура штучного нейрона Структура штучного нейрона Нейрон є складовою частиною нейронної мережі. Він складається з елементів трьох типів: помножувачів (синапсів), суматора і нелінійного перетворювача. Синапси здійснюють зв’язок між нейронами, множать вхідний сигнал на число, що характеризує силу зв’язку, (вагу синапса). Суматор виконує додавання сигналів, що надходять по синаптичним зв’язках від інших нейронів і зовнішніх вхідних сигналів. Нелінійний перетворювач реалізує нелінійну функцію одного аргументу – виходу суматора. Ця функція називається функцією активації чи передатною функцією нейрона. Математична модель штучного нейрона: LOGO

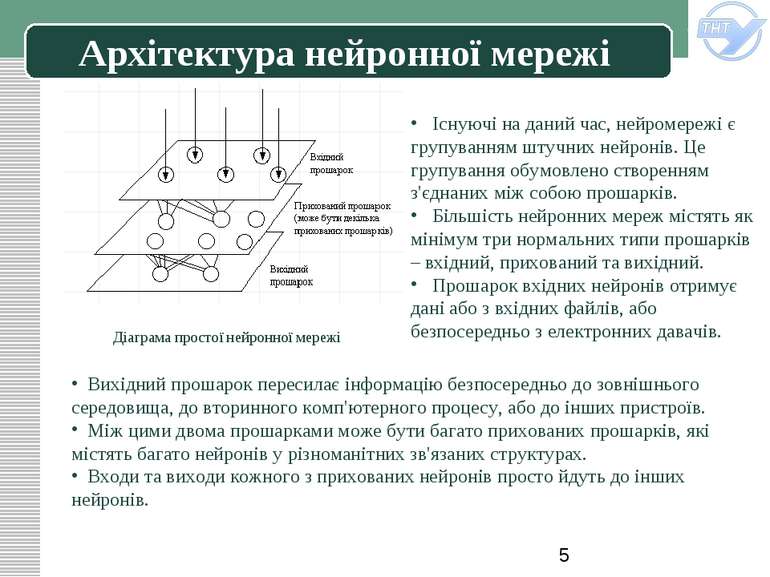

Архітектура нейронної мережі Діаграма простої нейронної мережі Існуючі на даний час, нейромережі є групуванням штучних нейронів. Це групування обумовлено створенням з'єднаних між собою прошарків. Більшість нейронних мереж містять як мінімум три нормальних типи прошарків – вхідний, прихований та вихідний. Прошарок вхідних нейронів отримує дані або з вхідних файлів, або безпосередньо з електронних давачів. Вихідний прошарок пересилає інформацію безпосередньо до зовнішнього середовища, до вторинного комп'ютерного процесу, або до інших пристроїв. Між цими двома прошарками може бути багато прихованих прошарків, які містять багато нейронів у різноманітних зв'язаних структурах. Входи та виходи кожного з прихованих нейронів просто йдуть до інших нейронів. LOGO

Навчання штучної нейронної мережі Існують три загальні парадигми навчання: "з вчителем“ - нейромережа має у своєму розпорядженні правильні відповіді (виходи мережі) на кожен вхідний приклад. Ваги налаштовуються так, щоб мережа виробляла відповіді як можна більш близькі до відомих правильних відповідей. "без вчителя" (самонавчання) - не вимагає знання правильних відповідей на кожен приклад навчальної вибірки. У цьому випадку розкривається внутрішня структура даних та кореляція між зразками в навчальній множині, що дозволяє розподілити зразки по категоріях. змішана - частина ваг визначається за допомогою навчання зі вчителем, у той час як інша визначається за допомогою самонавчання. LOGO

Навчання штучної нейронної мережі Правила навчання нейромережі: Правило Хеба. Wij(k)=r xj (k) yi (k), r - коефіцієнт швидкості навчання. Правило Хопфілда. Якщо одночасно вихідний та вхідний сигнал нейрона є активними або неактивними, збільшуємо вагу з'єднання оцінкою навчання, інакше зменшуємо вагу оцінкою навчання. Правило "дельта". Wij= xj (di - yi). Правило градієнтного спуску. До кінцевого коефіцієнта зміни, що діє на вагу, додається пропорційна константа, яка пов'язана з оцінкою навчання. Навчання методом змагання. Wij (k+1)= Wij(k)+r [xj - Wij(k)]. LOGO

Задачі прогнозування За характером основних ознак об'єкту: прогнозування явищ, реалізації яких представлені у вигляді детермінованих часових послідовностей. прогнозування явищ, реалізації яких представлені у вигляді ймовірнісних (індетермінованих) часових послідовностей. а) стаціонарної випадкової послідовності, яка характеризується однорідністю в часі, без суттєвих змін характеру коливань та їх середньої амплітуди; б) нестаціонарної випадкової послідовності, яка характеризується певною тенденцією розвитку в часі; За числом ознак об'єкту досліджень: одновимірна задача - явище представлене лише однією ознакою, зміни якої відбуваються в часі; багатовимірна задача - об'єкт або явище представлені кількома ознаками; За часом випередження розрізняють види прогнозів: згладжування, R= 0; короткотерміновий прогноз, R= 1… 2; середньотерміновий прогноз, R= 3 … 7; довготерміновий прогноз, R= 10 … 15. R - кількість кроків обчислення прогнозування. LOGO

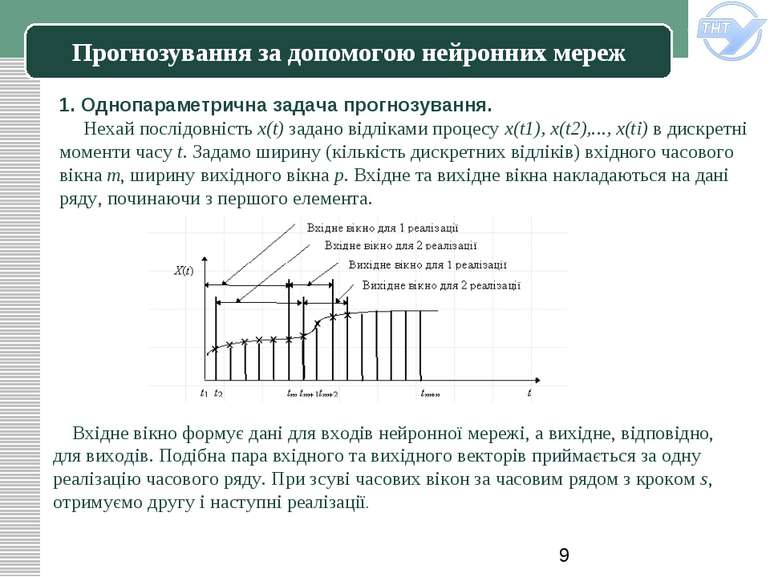

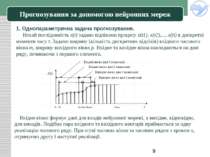

Прогнозування за допомогою нейронних мереж 1. Однопараметрична задача прогнозування. Нехай послідовність x(t) задано відліками процесу x(t1), x(t2),..., x(tі) в дискретні моменти часу t. Задамо ширину (кількість дискретних відліків) вхідного часового вікна m, ширину вихідного вікна р. Вхідне та вихідне вікна накладаються на дані ряду, починаючи з першого елемента. Вхідне вікно формує дані для входів нейронної мережі, а вихідне, відповідно, для виходів. Подібна пара вхідного та вихідного векторів приймається за одну реалізацію часового ряду. При зсуві часових вікон за часовим рядом з кроком s, отримуємо другу і наступні реалізації. LOGO

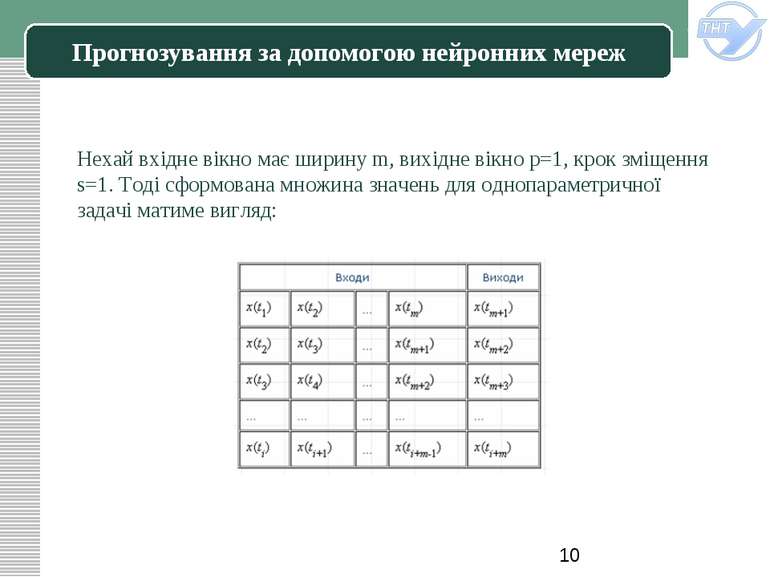

Прогнозування за допомогою нейронних мереж Нехай вхідне вікно має ширину m, вихідне вікно р=1, крок зміщення s=1. Тоді сформована множина значень для однопараметричної задачі матиме вигляд: LOGO

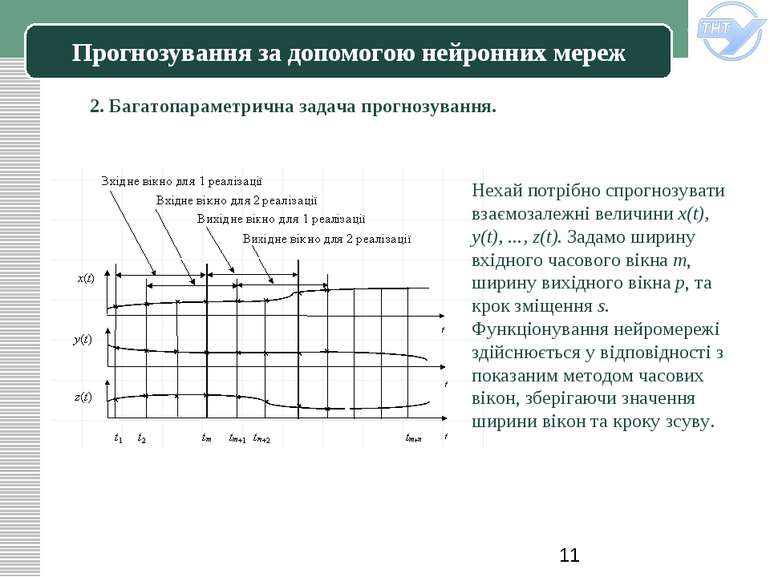

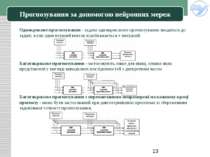

Прогнозування за допомогою нейронних мереж 2. Багатопараметрична задача прогнозування. Нехай потрібно спрогнозувати взаємозалежні величини x(t), y(t), ..., z(t). Задамо ширину вхідного часового вікна m, ширину вихідного вікна р, та крок зміщення s. Функціонування нейромережі здійснюється у відповідності з показаним методом часових вікон, зберігаючи значення ширини вікон та кроку зсуву. LOGO

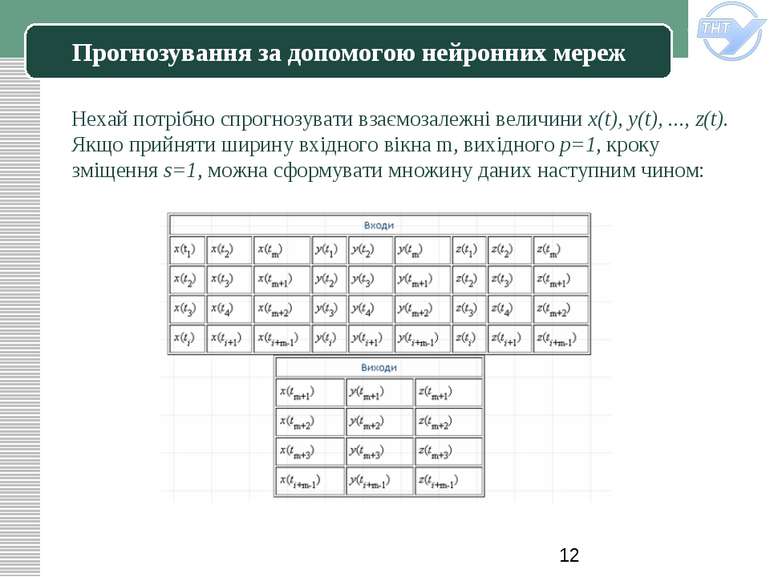

Прогнозування за допомогою нейронних мереж Нехай потрібно спрогнозувати взаємозалежні величини x(t), y(t), ..., z(t). Якщо прийняти ширину вхідного вікна m, вихідного р=1, кроку зміщення s=1, можна сформувати множину даних наступним чином: LOGO

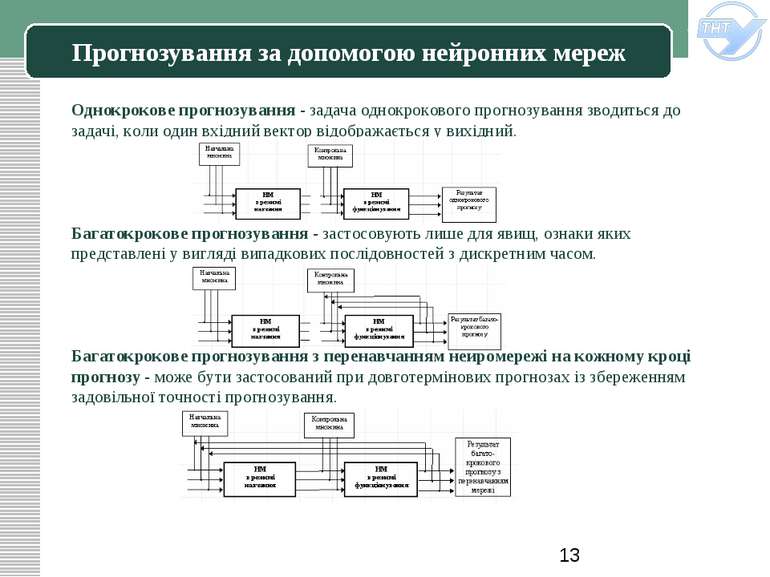

Прогнозування за допомогою нейронних мереж Однокрокове прогнозування - задача однокрокового прогнозування зводиться до задачі, коли один вхідний вектор відображається у вихідний. Багатокрокове прогнозування - застосовують лише для явищ, ознаки яких представлені у вигляді випадкових послідовностей з дискретним часом. Багатокрокове прогнозування з перенавчанням нейромережі на кожному кроці прогнозу - може бути застосований при довготермінових прогнозах із збереженням задовільної точності прогнозування. LOGO

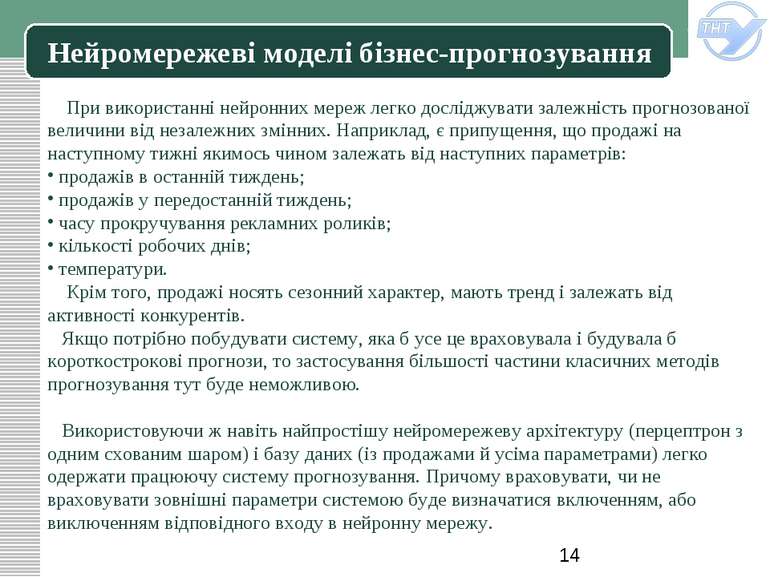

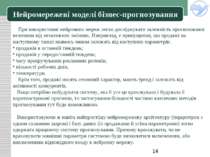

Нейромережеві моделі бізнес-прогнозування При використанні нейронних мереж легко досліджувати залежність прогнозованої величини від незалежних змінних. Наприклад, є припущення, що продажі на наступному тижні якимось чином залежать від наступних параметрів: продажів в останній тиждень; продажів у передостанній тиждень; часу прокручування рекламних роликів; кількості робочих днів; температури. Крім того, продажі носять сезонний характер, мають тренд і залежать від активності конкурентів. Якщо потрібно побудувати систему, яка б усе це враховувала і будувала б короткострокові прогнози, то застосування більшості частини класичних методів прогнозування тут буде неможливою. Використовуючи ж навіть найпростішу нейромережеву архітектуру (перцептрон з одним схованим шаром) і базу даних (із продажами й усіма параметрами) легко одержати працюючу систему прогнозування. Причому враховувати, чи не враховувати зовнішні параметри системою буде визначатися включенням, або виключенням відповідного входу в нейронну мережу. LOGO

Використання багатошарових перцептронів Застосування штучних нейронних мереж у завданнях бізнес-прогнозування – використання звичайного перцептрона з одним, двома, або трьома прихованими шарами. При цьому на входи нейронної мережі звичайно подається набір параметрів, на основі якого можна успішно прогнозувати. Виходом є прогноз мережі на майбутній момент часу. Графік, відображає історію продажів деякого продукту по тижнях. У даних помітно виражена сезонність. Для прогнозування на майбутній тиждень треба подавати дані про продажі за останні тижні, а також дані про продажі протягом декількох тижнів підряд рік тому, щоб мережа бачила динаміку продажів один сезон назад, коли ця динаміка була схожа на теперішню за рахунок сезонності. Якщо вхідних параметрів багато, рекомендується не скидати їх відразу в нейронну мережу, а провести перед обробку даних. LOGO

Література 1. http://masters.donntu.edu.ua/2003/fvti/paukov/library/neurow.htm 2. http://victoria.lviv.ua/html/oio/ 3. Уоссермен Ф. Нейрокомпьютерна техніка. - М.: Світ, 1992 4. Круглов В. В., Борисов В. В. Искусственные нейронные сети. Теорія и практика. – М.: Телеком, 2001. – 382 с. 5. Мак-Каллок У. С., Питтс В. Логическое исчисление идей, относящихся к нервной активности - М.: Изд-во иностр. лит., 1956. 6. http://www.neuroproject.ru/forecasting_tutorial.php#mlp 7. Нейронные сети. Саймон Хайкин. – М.: Вильямс, 2006. – 1103 с. LOGO

Схожі презентації

Категорії